Mondo e comunicazione / Critica della ragion digitale

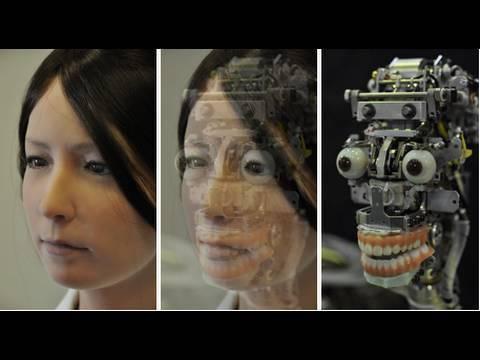

Questo ambiente digitale e sempre connesso ha mutato radicalmente alcune delle nostre esperienze, che dunque richiedono una nuova consapevolezza, nuove definizioni e nuove regole. Per esempio sta cambiando la “presenza”, un fenomeno polimorfico e un concetto polisemantico, intuitivo e insieme inafferrabile, che una volta si concretizzava nel “qui e ora” dell'incontro tra due esseri umani (tipico del teatro). La “telepresenza” minano alla radice – o arricchiscono – la nostra consapevolezza del Dasein, l'“essere qui” sui cui si basa il pensiero di Heidegger. E si stanno diffondendo cyborg sempre più realistici, sulla scia dei pionieristici robot sessuali,

“Oggi in queste macchine (sexbot) si cerca soprattutto uno strumento di piacere e i facsimile in vendita sono alquanto grezzi e tecnologicamente poco sofisticati. Ma domani potremmo trovare in commercio modelli più raffinati e realistici, sempre più simili agli esseri umani 'in carne e ossa' in grado di interagire con le persone sulla base degli stimoli vocali, visivi o tattili che riceveranno. A quel punto potranno anche aspirare a diventare un partner ideale, in quanto non sapranno soltanto riconoscere l'interlocutore, le sue emozioni e il suo stato d'animo, ma impareranno anche a individuarne le aspettative, i gusti e le preferenze.” (Maurizio Balistereri, Sex Robot. L'amore ai tempi delle macchine, Fandango, 2018, 18 €, p. 8)

All'Università di Osaka il team del giapponese Hiroshi Ishiguro ha creato gli androidi Geminoid, che possono essere animati in remoto (gesti e voce) dal loro modello umano. Hiroshi utilizza il suo doppio robotico mandandolo in sua vece a conferenze nei vari continenti, mentre il regista Hirata Oriza ha portato in teatro Geminoid F (la versione femminile) per una rivisitazione delle Tre sorelle di Cechov.

La telepresenza interferisce con la nostra percezione (o consapevolezza) dello spazio e del tempo, come sa benissimo chiunque abbia risposto a una telefonata (o a una chat) in un luogo pubblico: il nostro interlocutore diventa subito “più presente” di chi respira la nostra stessa aria. Ma la telepresenza, si chiede Floridi, “è un'esperienza personale e privata oppure qualcosa reso possibile solo dall'interazione sociale?” (p. 69)

Simmetricamente, anche il concetto di privacy richiede un nuovo approccio. Oggi lo smantellamento della privacy investe gli spazi pubblici. “Il giornale che compriamo, il bus che prendiamo, la maglietta che indossiamo, la bevanda che sorseggiamo” facevano parte della nostra sfera privata, ma ormai lo spazio urbano è infestato da telecamere di sorveglianza e smartphones: la nostra immagine può essere diffusa fuori dal nostro controllo in ogni momento e finire in qualche gigantesco database. Nella nostra intimità domestica gli assistenti digitali, lo smartphone e il televisore hanno occhi e orecchie (per non parlare dei cookies sui nostri pc). In questo contesto, i vecchi modelli e le vecchie regole, fondati sulla differenza tra spazi pubblici e spazi privati, non possono più funzionare. Il capitalismo della sorveglianza ha inevitabili ricadute filosofiche. La distinzione tra la vita domestica (la oikos) e la vita pubblica (la polis) è alla base della nostra concezione della politica e della democrazia. La distinzione tra i nostri atti e la nostra interiorità è il fondamento del libero arbitrio, ma gli algoritmi anticipano i nostri desideri, i nostri atti e i nostri consumi.

Il capitalismo della sorveglianza impone una profonda revisione dei termini fondamentali del pensiero filosofico, perché cambia l'orizzonte in cui si inseriscono e l'uso che ne viene fatto. Affrontare questi problemi con gli strumenti concettuali a cui siamo abituati moltiplica incongruenze e paradossi. Per affrontarli e provare a districarli, Floridi mette in campo alcuni attrezzi. Il primo è la teoria dell'informazione di Claude Shannon, con il suo schema di emettitore-canale-sorgente, debitamente arricchito. Il secondo è un atteggiamento costruttivo, il “design concettuale”, che ricorda a quello di uno scienziato che progetta esperimenti scientifici (“che non imitano il mondo, ma danno a esso forma con metodi controllabili”, p. 112), o di un programmatore che lavora a una nuova app. Il terzo attrezzo sono i “livelli di astrazione”, una rimodulazione della teoria dei tipi logici elaborata da Bertrand Russell e Alfred North Whitehead per superare il paradosso del mentitore: il cretese che dice che tutti i cretesi sono bugiardi, mente o dice la verità?

La stratificazione dei “livelli di astrazione” (o dei “livelli di realtà”) è peraltro ben conosciuta dalle arti, dai tempi della disputa tra Zeusi e Parrasio fino al “teatro nel teatro” di Luigi Pirandello, passando attraverso tutte le forme di mise-en-abyme. Nella complessità dell'attuale infosfera, artisti come Stelarc, Milo Rau, Rimini Protokoll e i Motus (e prima di loro lo Squat Theatre) esplorano proprio le fratture e le connessioni tra la realtà “fisica” (ammesso che esista) e i diversi livelli di rappresentazione attraverso l'esperienza dell'attore e dello spettatore. Le modalità in cui ci “interfacciamo” con gli altri e con la realtà non possono essere ricondotte solo a categorie logiche (come nei sistemi formali) ma sono il frutto di un complesso e continuo negoziato.

A essere messo in discussione è prima di tutto il concetto di identità personale, da cui dipende la “libertà che associamo alle idee di autodeterminazione e autonomia”. Floridi ricorda una celebre vignetta del “New Yorker” di qualche anno fa. Un cane va su internet e sorride all'amico quadrupede: “Tanto qui nessuno sa che sono un cane”. Oggi, non appena vado su internet, “qualcuno” sa – anche se non me lo ha mai chiesto e non gliel'ho mai detto – quanti anni ho, le mie preferenze sessuali, chi ho votato alle scorse elezioni e chi voterò alle prossime, che tipo di pasta comprerò al supermercato, qual è il mio sugo preferito, se preferisco Mozart a Bach (o a Mahamoud)... Io sono fermamente convinto della mia identità diacronica, cioè che sono la stessa persona che ero dieci anni fa, anche se nel frattempo sono cambiato (ahimè invecchiato) e le cellule del mio corpo hanno subito un processo di sostituzione. Tuttavia ho dimenticato moltissime cose che invece sono registrate in eterno sulla mia pagina Facebook e negli archivi di Google, che sa dov'ero minuto dopo minuto. Il nostro Io è da sempre (anche) un riflesso dello sguardo degli altri, ma ora è anche un insieme di informazioni (vere e false) sulle quali non abbiamo alcun controllo. La presenza online “ridefinisce limiti e opportunità nello sviluppo delle nostre identità, nella loro consapevolezza e nella loro comprensione sia personale sia collettiva” (p. 90-91). Anche la nostra percezione del tempo è stata deformata, sospesa tra l'eterno presente della connessione 24/7 e la memoria totale dei social.

La “critica della ragione digitale” di Floridi si concentra sulla fenomenologia dell'infosfera, in cui stiamo tutti “nuotando”, anche se non ci siamo accorti che l'acqua in cui ci muoviamo è molto cambiata. Anzi, l'abbiamo cambiata noi, perché l'infosfera è prima di tutto un prodotto sociale, oltre che tecnologico. La critica della ragione digitale deve sfidare anche questo versante, a cominciare da una delle critiche di ordine filosofico avanzate da chi riteneva semplicistica l'applicazione immediata della teoria dell'informazione alle interazioni tra gli esseri umani: perché il modello di Shannon rimuove il “livello di realtà” più elementare, quello della nostra corporeità (che non a caso è al centro della riflessione dei teatranti dai tempi di Antonin Artaud).

Quella di Meredith Broussard, che insegna alla New York University, è una critica radicale alla “artificial unintelligence”, ovvero l'incapacità dei computer di capire davvero la realtà (La non intelligenza artificiale. Come i computer non capiscono il mondo, FrancoAngeli, 2019, 25 €).

Il nume tutelare di Floridi è Alan Turing, l'inventore dell'omonimo test per distinguere l'intelligenza umana da quella artificiale. Il nume tutelare di Broussard è il filosofo americano John Searle, che ha messo in discussione il “test di Turing” con un altro esperimento mentale, quello della “Stanza cinese”, chiedendosi se davvero un computer è in grado di “capire” le frasi che traduce o può solo applicare un algoritmo. Ragioni filosofiche (etiche), logiche, cognitive e pratiche ci inducono a pensare che affidarsi del tutto ai computer per insegnare a un gruppo di adolescenti oppure guidare la nostra automobile nel traffico cittadino (o un aereo) non sarebbe davvero una buona idea: il suo saggio esplora alcune delle fallacie dell'intelligenza artificiale, in diversi che vanno dall'istruzione alla guida automatizzata al giornalismo.

Ma allora perché, nonostante tutti i suoi limiti, la visione algoritmica del mondo ha preso il sopravvento ed è diventata il perno del pensiero unico? La risposta di Broussard è fin troppo chiara:

“Abbiamo una piccola élite di uomini che tendono a sovrastimare le proprie capacità matematiche, che per secoli hanno sistematicamente escluso le donne e le persone di colore a favore delle macchine, che tendono a voler trasformare la fantascienza in realtà, che hanno scarso rispetto per le convenzioni sociali, che non credono che le norme e le regole della società si applichino a loro, che lasciano inutilizzate montagne di soldi del governo e che hanno adottato la retorica ideologica degli anarco-capitalisti libertari di estrema destra.” (p. 113)

Viene spontaneo iniziare l'elenco dei profeti della nuova utopia digitale che rispondono a questo identikit, anche perché stanno prendendo il controllo delle nostre vite individuali e sociali, ammassando fortune inimmaginabili. Per molti aspetti, i risultati non sono incoraggianti:

“Siamo riusciti a usare la tecnologia per aumentare le disuguaglianze, facilitare l'abuso illegale di stupefacenti, minare la sostenibilità economica della stampa libera, scatenare l'epidemia delle 'fake news', rimettere indietro le lancette dei diritto di voto e della protezione dei lavoratori, sorvegliare i cittadini, diffondere strampalate teorie scientifiche, molestare e perseguitare online le persone (perlopiù donne o persone di colore), costruire robot volanti che nel migliore dei casi danno fastidio e nel caso peggiore sganciano bombe, aumentare i furti di identità, consentire ai pirati informatici di rubare milioni di carte di credito a scopo fraudolento, vendere masse enormi di dati personali ed eleggere Donald Trump alla Casa Bianca.” (p. 250)

Le ricadute politiche della “quarta rivoluzione”, che stiamo faticosamente iniziando a decifrare, rappresentano solo la conseguenza più immediata e superficiale di una mutazione che incide molto più a fondo, come spiga Floridi, fino a disintegrare gli a-priori kantiani.

Broussard non è una feticista della tecnologia e nemmeno una luddista. Le piace scrivere codici e ama le novità. È persino salita su uno “Startup Bus”, ovvero una maratona competitiva tra programmatori (in gergo una hackaton) che lavorano in autobus che convergono verso la destinazione finale: all'arrivo questi nerd, che hanno smesso di dormire e si sono ingozzati di junk food per giorni e giorni, si sfidano per la vittoria e per i dollari degli investitori, i mitici venture capitalists che trasformano le start up in multinazionali multimiliardarie (non vi rivelo l'obiettivo di Pizzafy, la app del gruppo della Broussard, e nemmeno l'esito dello “Startup Bus”). Per i suoi studenti, la studiosa ha messo a punto un programma che usa i big data per mappare la contabilità dei comitati elettorali negli USA: i giornalisti alla ricerca di “buone storie” da raccontare ai loro lettori possono così individuare i finanziamenti che potrebbero aggirare le regole del settore. Insomma, uno strumento informatico e potente, che offre possibili spunti per il data journalism, le inchieste basate sui big data.

Il programma Bailiwick non scrive articoli in automatico (anche se esistono programma del genere), ma richiede nelle varie fasi l'intervento di un essere umano. È l'approccio human-in-the-loop, ovvero “l'essere umano nel ciclo”. L'espressione è ambigua, può assumere due significati: noi umani possiamo essere intrappolati e manipolati dal ciclo informatico degli algoritmi, oppure dobbiamo intervenire nei cicli e sui cicli, con una funzione di direzione e di controllo (e in questo senso lo intende Broussard).

Uno dei problemi che sta emergendo con chiarezza e gravità sempre maggiore sono i presupposti ideologici (spesso impliciti e inconsapevoli) di chi crea gli algoritmi, ovvero i loro “livelli di realtà” (o “livelli di astrazione”) in cui ciascuno di noi è immerso quotidianamente: gli algoritmi di riconoscimento facciale, progettati da giovani maschi bianchi caucasici, compiono molti più errori di fronte all'immagine di una persona di colore. Il completamento automatico di Google riflette i pregiudizi ideologici, razziali, sessuali degli utenti della piattaforma.

Un algoritmo non può avere capacità critiche (e autocritiche) in grado di accorgersi di problemi di questo genere, perché li crea (confidare nei metodi di machine learning significa solo spostare il problema di un livello, con il rischio di renderlo ancora più sistemico).

Il nostro rapporto con l'infosfera, a cominciare dai social, è una pratica individuale, ma è diventato un problema politico: le tecnologie dell'informazione e della comunicazione (ICT), annota Floridi, “hanno cambiato profondamente molti aspetti della vita, inclusa la natura di comunicazione, formazione, lavoro, intrattenimento, produzione e commercio industriali, sanità, relazioni sociali e conflitti armati” (p. 128). Il campo di gioco è stato distorto e sta plasmando anche i giocatori, la loro identità, il loro senso del tempo, dello spazio, della storia, del loro rapporto con sé stesi e con gli altri. Servono nuovi sguardi, nuove parole, nuove regole. La filosofia, in quanto amore per la conoscenza, con questo si deve misurare. Ricordando che “la conoscenza non consiste nel ricevere un messaggio dal mondo; essa concerne in primo luogo il modo in cui negoziamo la corretta tipologia di comunicazione che intratteniamo con il mondo” (p. 100).